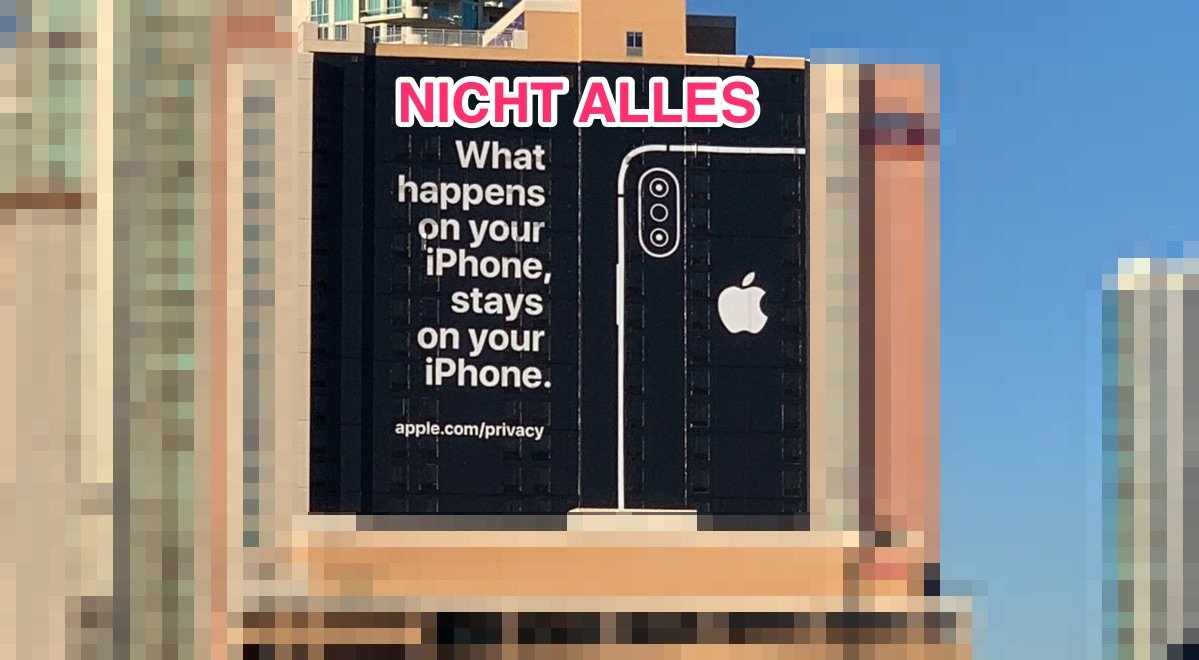

Sex, Drogendeals & Arztgespräche – Nicht alles, was auf dem iPhone passiert, bleibt auch auf dem iPhone. Während Apple Privatsphäre und Datenschutz als Verkaufsargument präsentiert scheint der Sprachassistent Siri ebenfalls private Daten und Gespräche an externe Subunternehmer zur Analyse und Verbesserung des Dienstes weiterzuleiten. Bei Amazon Alexa und Google Assistant dürfte die Speicherung und Analyse von aufgenommenen Gesprächen klar sein – dass auch Apple diese Siri-Aufnahmen an Vertragspartner weiterleitet blieb bislang eher im Verborgenen.

Gegenüber The Guardian hat ein solcher Vertragspartner nun klargestellt, dass für die Verbesserung des Apple Sprachassistenten Siri zahlreiche Gespräche analysiert werden und ein großer Anteil davon auch ungewollte Aufnahmen sind, die durch eine versehentliche Aktivierung von Hey Siri aufgezeichnet wurden (oder einem beliebigen Geräusch, das den Assistenten aktiviert – oder dem einfachen Anheben des Armes bei der Apple Watch). Dabei werden zwar die Aufzeichnungen „pseudonymisiert“ und können keiner Apple ID direkt zugeordnet werden, der Whistleblower erklärt jedoch:

Es gab unzählige Fälle von Aufnahmen mit privaten Gesprächen zwischen Ärzten und Patienten, Geschäftsabschlüssen, scheinbar kriminellen Geschäften, sexuellen Begegnungen und so weiter. Diese Aufzeichnungen werden von Benutzerdaten mit Standort, Kontaktdaten und App-Daten begleitet

Was ebenso den wenigsten bewusst sein dürfte: Apple gibt an, dass weniger als 1 Prozent der Siri Aktivierungen dafür verwendet werden, den Assistenten zu verbessern – im Zweifel werden also 1 Prozent der Sprachbefehle an Siri tatsächlich von echten Menschen abgehört. Apple erklärt gegenüber dem Guardian:

Ein kleiner Teil der Siri-Anfragen wird analysiert, um Siri und Diktat zu verbessern. Benutzeranfragen sind nicht mit der Apple-ID des Benutzers verknüpft. Siri-Antworten werden in sicheren Einrichtungen analysiert, und alle Prüfer sind verpflichtet, die strengen Vertraulichkeitsanforderungen von Apple einzuhalten.

Dabei scheint die versehentliche Aktivierung von Siri viel häufiger vorzukommen als man dies annehmen dürfte und so laufen tatsächlich sehr viele Gesprächsschnipsel bei den Lauschern auf, die niemals für Siri bestimmt waren. Dabei gibt es kein Prozedere für solche „sensible Aufnahmen“ – diese werden einfach als technisches Problem gemeldet.

Es gibt nicht viele Überprüfungen darüber, wer dort arbeitet, und die Menge der Daten, die wir durchsuchen können, scheint ziemlich groß zu sein. Es wäre nicht schwer, die Person zu identifizieren, die Sie hören, besonders mit zufälligen Auslösern – Adressen, Namen und so weiter.

Apple vergibt die Aufträge an Subunternehmer, es gibt eine hohe Fluktuation. Es ist nicht so, dass die Menschen ermutigt werden, Rücksicht auf die Privatsphäre der Menschen zu nehmen oder sie sogar zu berücksichtigen.

Im Gegensatz zu Amazon und Google bietet Apple keine Möglichkeit an, bestimmte Nutzungen der eigenen Aufnahmen zu widersprechen. Hier bleibt lediglich die komplette Deaktivierung von Siri.

Was wir uns aber am Ende nun fragen: wenn Apple tatsächlich ein Prozent der Siri Anfragen zur Verbesserung des Dienstes analysiert und somit also eigentlich „das Gleiche“ wie Amazon und Google macht – warum ist dann der Sprachassistent Siri so weit hinter den anderen zurück?

Was Denkst Du?